2. 机器人视觉感知与控制技术国家工程实验室(湖南大学), 湖南 长沙 410012

2. Robot Visual Perception & Control Technology National Engineering Laboratory, Changsha 410012, China

现实生活中存在大量的圆形图像目标识别问题, 例如车标、图标、图徽、商标、标签、硬币、装饰物上的圆形花纹和图案等.在很多场合, 圆形图像印制、摆放的角度具有随意性, 因此图案常出现不同角度的旋转.为了解决现实场景中圆形图像目标的识别, 首先要保证在特征提取和图像描述时的抗旋转变换能力, 这样才能保证在只获得少量特定角度训练样本前提下实现任意角度圆形图像目标的识别, 从而避免搜集和存储大量的各种角度的圆形图像样本.以往的文献中没有专门针对圆形图像目标识别的研究, 但是在各种应用案例中有相关的研究报道, 例如对硬币图案的识别、车标的识别、LOGO标签的识别等.

图像目标识别一直是计算机视觉领域的热点研究问题, 其通常包括图像预处理、特征提取与描述、分类器设计与学习等环节, 其中, 特征提取与描述最为关键, 需要综合考虑鉴别能力、计算复杂性和鲁棒性等因素.针对圆形图像目标的识别问题, 我们希望构建一种具有广泛适用性的抗旋转高效高鉴别的特征提取与描述方法.

图像目标检测与识别的常用特征描述算子分为浮点型和二值型两类:浮点型描述子通常基于梯度计算, 通过梯度值和梯度方向信息进行描述, 著名的有SIFT[1], SURF[2], MROGH[3], HOG[4]等, 其优点是鉴别能力强, 但计算量大比较耗时.二值描述算子中有代表性的是LBP[5], BRIEF[6], ORB[7], BRISK[8], FREAK[9]等, 二值描述算子通常直接比较图像像素之间灰度大小, 优点在于计算简单, 计算和匹配效率高, 缺点是由于量化信息损失, 其鉴别能力较弱.

为了实现抗旋转特征提取和图像描述, 需要考虑两个方面的问题:一是在特征计算时应该具有抗旋转变换能力, 二是通过池化操作对图像做整体描述时应该具有旋转不变性.方向校正是特征计算和池化操作常用的抗旋转技术手段, SIFT和SURF算子通过估计局部主梯度方向作为参考方向, 然后做适当的方向校准实现抗旋转变换.但由于梯度方向估计可能存在±20°的误差[10], 因此易导致偏差.LBP为了获得旋转不变特征模式[5], 则通过排序策略找到具有最小模式值的模式特征作为代表模式.该处理策略在梯度方向直方图中也可以借用, 例如找到最大梯度方向, 然后以此为基准, 按顺时针或逆时针方向重新排列梯度方向直方图.但是此类方法易受噪声和其他因素干扰, 有时难以获得稳定的排序关系.也有研究人员采用成对特征点的梯度方向夹角取代方向, 由于夹角和旋转无关, 因此可实现旋转不变描述[11].构建局部坐标系统也是在特征计算阶段常用的一种抗旋转变换策略, 例如樊彬的局部旋转不变坐标系统[10]、文献[12]采用的径向梯度变换, 局部坐标系统在获得旋转不变性能力上, 具有严谨的理论支撑, 有相对稳定的性能.

在对图像整体描述时的特征池化操作中, 通常会采用格状空间划分, 但如果不做方向校正的话, 格状空间不具备旋转不变性.现有文献中, 最典型的旋转不变描述有环状空间划分[13]和基于灰度排序的池化策略[14].

● 环状空间划分原理简单, 具有天然的旋转不变性, 因此在做旋转不变描述时, 其特征表达最为稳定.但由于对图像空间的描述比较粗糙, 造成空间信息损失, 因此特征鉴别能力不强.这也是很多特征描述方法不采用环状空间划分而往往采用格状空间划分的原因, 例如SIFT, HOG等;

● 灰度排序则通过对灰度区间的量化和排序实现和旋转无关的图像描述, 其在实际应用中也有不错的性能表现.但是灰度强度易受照明的影响, 此外, 该方法对目标遮挡和污渍敏感, 因此实际应用中也有较大的局限性.

鉴于上述分析, 本文提出一种针对圆形图像目标的抗旋转高效高鉴别特征提取与描述方法.该方法为了解决特征计算的抗旋转能力, 采用了径向变换技术, 同时, 充分利用了圆形图像目标本身呈中心对称的外观特点, 采用环状空间特征池化策略, 并且利用空间对称区域结构的描述提升了环状空间描述的鉴别能力.此外, 由于该方法属于二值模式特征, 其继承了传统二值模式特征计算和匹配高效的优点.

1 抗旋转对称结构模式特征提取 1.1 现有LBP模式计算原理及缺陷局部二值模式(local binary pattern, 简称LBP)是一种简单有效的特征提取算法, 原LBPp, r是通过比较中心像素和半径为r的圆形邻域的P个像素点的灰度大小来实现微观邻域结构的描述.LBP具有原理简单、单调照明变化不变性等优点, 改进后的LBP具有旋转不变性, 因此广泛应用在图像匹配与图像识别等领域, 特别是在纹理分析与人脸识别领域.

为了降低模式数目, 可以只保留有重要意义的模式结构, 因此, 研究人员提出了统一模式

| $LBP_{p, r}^{{r_i}{u_2}} = \left\{ {\begin{array}{*{20}{l}} {\sum\nolimits_{p = 0}^{p - 1} {S({g_p} - {g_c})} , }&{{\rm{ }}U(LB{P_{p, r}}) \leqslant 2} \\ {p + 1, } &{\rm{ otherelse}} \end{array}} \right.$ | (1) |

其中,

|

Fig. 1 Illustration of the calculation of LBP and |

考虑到圆形图案的外观特点, 在进行图像整体描述时, 为了获得旋转不变性, 我们很自然地考虑采用环形特征池化操作.但是环形空间划分本身鉴别能力弱, 不利于后续识别.如果采用经典的旋转不变统一模式特征

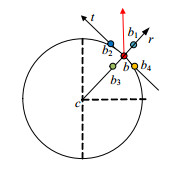

为了获得旋转不变描述, 我们引入局部径向坐标变换技术, 并按照给定样本点的径向与切向方向选取邻域点进行编码.提取样本点b的旋转不变二值模式原理如图 2所示:c为图像中心, 沿cb方向称为径向坐标轴, 垂直cb方向称为切向坐标轴, b为新的局部坐标系统原点.分别在径向r和切向t方向找到对称的与p点的距离为d的4个邻域点, 沿逆时针分别记作b1, b2, b3, b4, 其中, 径向方向上的邻近点为b1, b3, 切向方向上的邻近点为b2, b4, 然后按照b1, b2, b3, b4的顺序与b点的像素值进行比较, 由公式(2)得到二进制数编码T=(T1T2T3T4):

|

Fig. 2 Diagram of local radial coordinate transformation 图 2 局部径向坐标变换示意图 |

| ${T_i} = \left\{ {\begin{array}{*{20}{l}} {1, {\rm{ }}I({b_i}) > I(b)} \\ {0, {\rm{ }}I({b_i}) \leqslant I(b)} \end{array}} \right., i = 1, 2, 3, 4$ | (2) |

将4位二进制数T按下式转化为10进制数, 即可得到对应的编码值:

| $ F=8 \times T_{1}+4 \times T_{2}+2 \times T_{3}+T_{4} $ | (3) |

其中, I(b)为b点的像素值, I(bi)为所取点bi的像素值, F为编码值.该二值编码方法可以描述16种二值模式, 与旋转不变统一模式相比, 其不仅具有旋转不变性, 而且可以表示更多的细节信息.

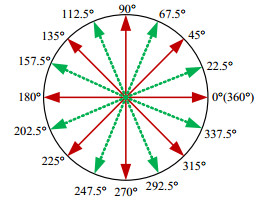

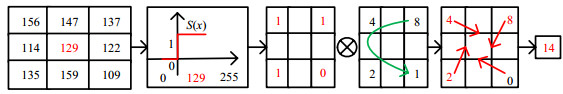

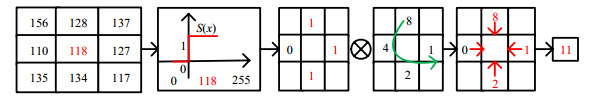

在构建局部坐标系统时, 需要进行浮点数插值计算, 这需要大量的计算时间代价.为了避免插值计算, 提高计算速度, 我们可以采用近似计算, 其原理如图 3所示:在圆形区域内, 将图像中心径向方向以45°为单位, 划分8个扇区, 如图 3虚线所分隔扇区.环状空间中采样点的近似编码计算示例如图 4~图 7所示.

|

Fig. 3 Sector schematic for radial approximate coding 图 3 径向近似计算的扇区示意图 |

|

Fig. 4 Location of points A, B, C 图 4 点A, B, C所在位置图 |

|

Fig. 5 Encoding calculation process of point A 图 5 点A编码计算过程图 |

|

Fig. 6 Encoding calculation process of point B 图 6 点B编码计算过程图 |

|

Fig. 7 Encoding calculation process of point C 图 7 点C编码计算过程图 |

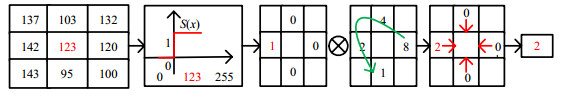

如图 4所示, 假设点A, B, C分别为圆上一点, 它们与图像中心夹角分别为θA < 22.5°, 22.5° < θB < 67.5°, 67.5° < θC < 112.5°, 图 5~图 7给出了3个点在3×3邻域内的近似编码计算实例.此时, 点A的编码起始位置b1为邻域水平方向右边像素点, 即图 5中像素值为120的位置, 按逆时针方向分别取右、下、左、上这4个点进行编码.对于点B来说, 则编码起始位置b1为邻域右上角像素点, 即图 6中像素值为137的位置, 此时按右上、右下、左下、左上的顺序取对角线的4个点, 实现逆时针编码.而点C的编码起始位置b1则为邻域垂直方向上方像素点, 即图 7中像素值为128的位置, 按上、右、下、左顺序取4个点实现逆时针编码.点A, B, C编码计算过程示意图分别如图 5~图 7所示.

1.3 环形空间对称结构模式提取在对圆形物体ROI区域中的每个点进行编码后, 考虑到圆形图案中心对称的特点, 我们采用环状空间特征池化策略; 同时, 为了提升环状空间描述的鉴别能力, 我们提出空间对称结构对的方式提取成对点的特征模式.

由于圆形物体的ROI区域为圆形, 因此可将该区域按照等面积的原则划分为若干个交叠的圆环区域, 如图 8所示, 其中, 第m个圆环包含的区域半径为

|

Fig. 8 Schematic diagram of symmetrical structure 图 8 对称结构模示意图 |

| $\left\{ {\begin{array}{*{20}{l}} {i' = 2{x_0} - i} \\ {j' = 2{y_0} - j} \end{array}} \right.$ | (4) |

分别对(i, j)与其对称点(i', j')按照第1.2节所述的径向坐标变换方式计算其局部二值模式和编码值, 其中, 点(i, j)编码值记为F1, 点(i', j')编码值记为F2.为了确保点对模式编码与旋转无关, 有必要按照大小排序关系进行组合.如果F1 > F2, 则点对模式表示为(F1, F2), 否则表示为(F2, F1).统计圆环内所有点对, 按照出现频率即可获得该圆环内所有点对模式的直方图描述, 记作hm.根据组合关系, 模式对有162=256种组合, 因此, hm是一个256维的特征向量.考虑到对称性, 实际计算时, 点(i, j)只需要在圆环上半部分取样, 这可以避免不必要的重复统计.

影响模式对统计稳定性的因素主要有两个:一是ROI区域中心位置估算误差, 二是图像噪声和干扰.为了获得稳定的统计结果, 我们不是直接统计单个点对的直方图, 而是在当前点(i, j)和对称点(i', j')一定邻域内各自寻找代表性模式作为该点的模式表示.根据实际图像不同的特点, 我们设计了两种方式.

● 如果圆形图案纹理细节信息比较丰富, 则我们采用主模式选择编码.即:在点(i, j)的M×M邻域内统计出现次数最多的编码模式值, 将该模式值作为点(i, j)的代表模式, 记为F1; 同样统计对称点(i', j')的代表模式, 记为F2, 我们将这种特征提取方式称为邻域代表模式;

● 如果圆形图案主要由线条、边缘轮廓构成, 没有丰富的纹理细节, 则我们采用主梯度选择编码.即:寻找点(i, j)的M×M邻域内梯度幅值最大的点, 并取其径向变换二值模式值作为点(i, j)的代表模式, 记为F1; 按同样原理确定对称点(i', j')的代表模式, 记为F2.我们将这种特征提取方式称为邻域主梯度代表模式.需要注意的是, 在计算梯度时, 同样应该在新的局部径向r, t坐标系统内进行计算, 这样才能保证旋转不变性.

将圆形物体所在的ROI圆形区域按等面积划分为n个交叠圆环, 计算每个圆环内的对称结构模式对; 然后统计圆环内的特征模式对直方图, 记为hm(256维的特征向量); 最终, 按从内环到外环的顺序组装起来得到最终的图像特征描述:

| $ H=\left(h_{1}, h_{2}, \ldots, h_{n}\right) $ | (5) |

其中, hm表示第m个圆环的特征向量, m=1, 2, ..., n.

1.4 抗旋转对称结构模式特征提取算法抗旋转对称结构模式特征提取算法步骤如下.

1) 提取圆形图像ROI区域, 并确定其中心位置;

2) 对于ROI区域内每个点, 按照局部径向坐标变换选取4个邻域点, 并采用近似计算方式, 计算该点的抗旋转编码模式值;

3) 将整个ROI区域按照等面积的原则划分出相互交叠的n个圆环;

4) 依次统计第m个(m=1, …, n)圆环内关于圆形区域中心点O对称的点对(i, j)与(i', j')的模式, 并选择主模式编码或主梯度选择编码方式, 统计完圆环内所有点对后, 按照出现频率即可获得该圆环内所有模式对组合的直方图描述, 记作hm;

5) 将n个圆环提取到的特征向量, 按照从内环到外环顺序组装得到最终的图像特征描述, 记为

| $ H=\left(h_{1}, h_{2}, \ldots, h_{n}\right) $ |

实验采用了欧元硬币、QQ表情和车标这3个数据集.欧元硬币数据集由12个主要欧盟国家的欧元硬币组成, 所有国家硬币正面图案相同, 反面图案由每一个国家自行设计, 均不相同.硬币数据集包含2欧元、1欧元、50欧分、20欧分、10欧分5种币值, 我们采集了不同币值的正反面硬币图像8 430张.其中, 2欧元2 603张, 1欧元2 240张, 50欧分1 030张, 20欧分1 291张, 10欧分1 266张.图 9给出了德国、卢森堡和葡萄牙的5种币值的反面图案.硬币检测的目的是通过识别反面图案实现硬币国别的判别.

|

Fig. 9 Part of the euro coin figures 图 9 部分欧元硬币图片 |

QQ表情数据集是截取腾讯聊天软件中的表情获得的, 共包括52种不同的表情, 每种表情图片按5度加以旋转, 可扩充为72张图片, 总共获得3 744张图片.QQ表情图片示例如图 10所示.

|

Fig. 10 Part of QQ expression pictures 图 10 部分QQ表情图片 |

车标数据集通过对各种车型的网上实物图像截取、建立.我们专门选择了15种近似圆形的车标图案, 其中, 每种车型截取了100张图片, 共1 500张, 部分车标图片如图 11所示.

|

Fig. 11 Part of the car logo pictures 图 11 部分车标图片 |

表 1给出了3个数据集的基本信息.我们之所以采用上述3个数据集, 是因为这3个数据集有各自不同的特性.它们在色彩、纹理、光照、图案复杂程度方面有明显差异, 这可以充分检验方法的适应性和鲁棒性.

| Table 1 Experimental dataset basic information 表 1 实验数据集信息 |

数据图像中目标的ROI圆形区域对本文算法特征提取具有重要作用.由于欧元硬币图像有确定的单一背景, 通过简单的背景差分和形态学操作, 较容易确定硬币的位置和ROI区域.而对于QQ表情和车标图片, 由于我们重点关注的是圆形图像识别的问题, 因此在收集数据集时, 我们已经人为地将圆形图像目标从原图中剪切并保存下来, 后续算法只需在剪切下来的方形子图中做内切圆即可确定其ROI圆形区域.

2.2 实验结果与分析本文方法是基于圆形图像呈现中心对称的特点而设计的, 通过径向变换技术和邻域模式选择策略, 特征表达对于旋转和噪声具有较强的鲁棒性.因此, 该方法命名为“中心-对称鲁棒二值模式”, 简记为CS_RBP(central symmetry robust binary pattern).由于本文方法和传统的LBP方法以及HOG方法在特征提取和采样方式上相似, 因此我们主要比较LBP, HOG方法, 以及采用类似的中心对称结构和邻域模式选取策略的LBP方法和本文提出的CS_RBP方法在欧元硬币数据集、QQ表情数据集和车标数据集这3个圆形图案数据集上的实验结果.其中, 分类器模型选择的是线性SVM.

2.2.1 关键参数选取实验有两个重要参数对CS_RBP方法检测性能影响较大:一是环形空间的数目; 二是在选择邻域代表模式时, 邻域窗口的大小.为了获得最佳识别性能, 有必要通过实验方式确定合适的参数值.以硬币图像为例, 表 2给出了将硬币图像归一化为200×200后, 邻域M×M取为3×3, 5×5, 7×7, 9×9, 11×11这5种模式, 圆环个数m分别取16, 18, 20, 22, 24, 26, 28等情况下的硬币国别识别结果.

| Table 2 M×M neighborhood size and number of rings m selection experiment 表 2 M×M邻域大小及圆环个数m选取实验 |

从实验结果观测可知, 邻域大小的选取比环状空间数目更为重要.在同等邻域大小下, 环状空间数目对识别性能的影响比较小, 检测结果波动幅度很小.表 2中, 每一行加粗的数据是在该邻域大小下, 在某环状数目下的最好识别结果.在3×3邻域时, 环数为20, 22, 24时有最好结果; 而在5×5邻域时, 环数为28时有最好结果; 7×7邻域时, 环数为26时有最好结果; 9×9邻域时, 环数为16时有最好结果; 11×11邻域时, 则环数为28时有最好结果.在同等邻域下, 环数取多少有最好结果没有明显的规律.同时可观测到:随着邻域增大, 9×9和11×11两组实验结果的波动相对比邻域窗口较小的3×3, 5×5和7×7的实验结果波动幅度要大一些.另外, 观测每一列的数据可知:在环数固定后, 邻域过大和过小都会导致识别性能下降.在所有7列数据中, 除了环数22时, 5×5邻域有最好结果外(下划线数据), 其他列中均是在邻域7×7时取得最佳识别性能.最终的最好识别结果为100%, 其中邻域为7×7、环数26.鉴于上述实验结果, 7×7邻域、环数26是一组较佳的参数.在后续实验中, 我们均选用该组参数进行实验测试和比较.

2.2.2 不同算法在3个数据集上的实验针对欧元硬币数据集、QQ表情数据集和车标数据集, 我们分别采用不同比例的训练样本进行实验.用来比较的LBP特征是最常用的LBP统一旋转不变模式

| Table 3 Euro coin recognition accuracy 表 3 欧元硬币数据集识别率 |

| Table 4 QQ expression recognition accuracy 表 4 QQ表情数据集识别率 |

| Table 5 Car logo recognition accuracy 表 5 车标数据集识别率 |

由表 3~表 5可以看出:在3个数据集上, 所有方法被分成5组, 其中, 第1组为表中第2行, 第2组为表中第3行、第4行, 第3组为表中第5行~第8行, 第4组为表中第9行~第12行、第5组为表中第13行~第16行.在传统LBP方法组中,

LBP方法比较适合提取纹理特征, 但是在纹理信息比较缺乏的QQ表情和车标数据集中, 对应的LBP方法的性能远低于本文的方法.这也说明本文方法适应性强, 对于纹理丰富和纹理缺乏的图像均能适用.值得注意的是:邻域半径增大后, 很多时候CS_RBP4, 2并没有取得CS_RBP4, 1更好的性能, 反而还有所下降.原因是局部径向坐标变换的旋转不变二值模式的近似计算在半径增大后, 计算误差会增加, 尤其是当图像邻域中含有细节纹理信息时, 例如在含有较多纹理信息的硬币数据集和因为色差产生的具有纹理变化的QQ表情数据集测试时.

由表 3~表 5可知:在训练集占比为8%的欧元硬币数据集与占比为16%的QQ表情数据集上, 能够达到的最好识别率100%均为本文方法所取得; 只有在车标数据集中, 获得的最好识别率100%由HOG方法取得.同时, 我们可观察到:只需要较少比例的训练样本, 例如欧元硬币数据集中训练集占比为8%、QQ表情数据集中训练集占比16%, 本文方法均达到100%的识别率.但是对于车标数据集, 尽管车标图案不旋转, 但是由于图像在自然场景下获取, 背景、照明和视角均有较大变化, 因此仍然需要较多的训练样本, 本文方法才能保证其识别性能.

由于HOG特征本身没有考虑旋转不变性问题, 因此其对于旋转图案识别效果不理想, 特别是在样本数较少的情况下, 由于样本很难涵盖各种旋转角度, 此时HOG方法识别性能较差.例如在硬币数据集中, 在训练样本数为2%时, HOG特征识别率只有57.46%, 而LBP和CS_RBP邻域代表模式能达到90%以上的识别率; 在训练样本数为4%时, HOG特征识别率只有67.73%, 而LBP和CS_RBP邻域代表模式多数情况能达到95%以上的识别率; 在训练样本数为8%时, HOG特征识别率虽然可以达到83.44%, 但是仍远低于LBP, CS_RBP邻域代表模式和邻域主梯度代表模式的识别率.在QQ表情图像集中, 相似的情况也能在HOG方法和CS_RBP邻域主梯度代表模式中观察到.但是对于车标数据集, 由于车标图像本身无旋转变化且边缘结构信息显著, 此时HOG特征表现优异, 在训练样本占比15%, 30%, 45%这3种情况下都得到了100%的识别准确率.这是因为HOG特征描述利用的是梯度信息, 其在对抗照明变化上要优于LBP和CS_RBP特征方法.但是一旦图像发生旋转, 则HOG特征的性能难以得到保证, 这在欧元硬币的检测和QQ表情数据集中已经得到验证.

2.2.3 计算效率比较CS_RBP作为二值描述算子, 计算原理简单, 与其他二值描述算子一样具有高效的优点.表 6给出了几种代表性的浮点数值型描述子HOG, SIFT和SURF, 以及二值描述算子BRIEF, FREAK和本文CS_RBP方法在进行单点特征提取所花时间的比较.其中:HOG单个Cell特征提取约耗时1.9ms; SIFT和SURF算子需要2.5ms和1.4ms; 而CS_RBP方法只需0.045ms, 效率是HOG的42倍、SIFT的56倍、SURF的31倍.由于CS_RBP在寻找对称模式时计算原理比BRISK和FREAK复杂一些, 因此时间消耗上略有增加.CS_RBP算法运行环境:CPU为i5-4590, 4GB内存, Matlab 2014a.

| Table 6 Comparison single point feature extraction time of different descriptors 表 6 描述子单个点特征提取时间比较 |

2.2.4 抗旋转性能测试

为验证本文算法特征的抗旋转特性, 以德国2欧元硬币背面图像为例, 如图 12所示, 分别提取初始样本和旋转不同角度后该硬币图像的特征, 特征向量之间的相关度由公式(6)计算:

|

Fig. 12 Test picture rotation schematic 图 12 测试图片旋转示意图 |

| $ P({H_Y}, {H_M}) = \frac{{\langle {H_Y}, {H_M}\rangle }}{{\sqrt {\langle {H_Y}, {H_Y}\rangle } \sqrt {\langle {H_M}, {H_M}\rangle } }} $ | (6) |

其中, HY和HM分别表示初始样本图片和旋转后图片的特征向量, ⟨·, ·⟩表示向量内积.

P(HY, HM)表示HY和HM的相关系数, 可以衡量特征的抗旋转能力, 平均相关度越大且标准差越小, 则抗旋转性越强.每次旋转15度, 我们计算了原始图像和旋转后图像的特征相关度, 表 7给出了本文4种方法和LBP, HOG特征在图像旋转后的相关度值.

| Table 7 Average correlation of the features after rotation of the sample images 表 7 样本图片旋转后的特征平均相关度 |

从表 7可知, 本文的4种算法在每个旋转角度的相关度均比HOG特征高, 同时标准差也较小.本文4种算法的平均相关度分别为0.845, 0.905, 0.885, 0.789, 远高于HOG特征的0.614, 其中, CS_RBP4, 2邻域代表模式表现最为稳定, 平均相关度值达到0.905, 标准差0.035.LBP特征模式我们采用的是旋转不变模式, 因此其本身具有旋转不变性, 在所有旋转角度情况下, 其特征相关度均为1.尽管如此, 但是LBP旋转不变模式信息损失较大, 不利于图像细节的描述, 因此特征的鉴别能力不足.而本文方法在尽可能保留抗旋转描述特性的同时, 利用空间对称位置结构信息有效提高了特征的鉴别能力, 从而达到抗旋转高鉴别二值模式特征提取的目的.

2.2.5 原始特征计算方法和近似计算方法对比在基于局部径向坐标变换的旋转不变二值模式计算时, 我们采用了近似计算方法.为了验证近似方法的可靠性, 与原始算法进行了对比测试.考虑到原始特征计算方法相当耗时, 我们只选取了部分欧元硬币进行实验, 其中, 2欧元硬币580张, 1欧元硬币552张, 50欧分硬币252张, 20欧分硬币312张, 10欧分硬币312张, 实验结果见表 8.

| Table 8 Initial feature calculation method is compared with the recognition result of approximate calculation method in euro coin recognition 表 8 原始特征计算方法与近似计算方法在欧元硬币识别上的识别结果对比 |

从表 8可看出, 4种情况下的原始特征计算方法与近似计算方法上在最终的分类精度上相差无几; 而近似计算方法由于避免了大量的浮点数插值计算, 从而大大提高了计算效率; 原始特征计算方法对200×200大小的图像进行的特征提取耗时约30s, 而近似计算办法耗时仅需1s.

3 总结针对圆形图案中心对称的特点, 本文提出一种基于空间对称结构模式对的图像二值特征描述方法.由于引入了局部径向变换技术, 在抗旋转特性的同时, 使得能够表达的基本模式达到16种, 多于

作者注 本文是我们于2017年5月24日投到《软件学报》的论文, 该文是湘潭大学张东波老师指导的2018届(2018年6月)毕业的研究生陈红磊(本文第二作者)的硕士论文《基于计算机视觉的欧元硬币识别》工作成果的一部分.特此说明.

| [1] |

Lowe DG. Distinctive image features from scale-invariant keypoints. Int'l Journal of Computer Vision, 2004, 60(2): 91-110.

[doi:10.1023/B:VISI.0000029664.99615.94] |

| [2] |

Bay H, Tuytelaars T, Van Gool L. SURF: Speeded up robust features. In: Proc. of the European Conf. on Computer Vision. 2006. 404-417.[doi: 10.1007/11744023_32]

|

| [3] |

Mikolajczyk K, Schmid C. A performance evaluation of local descriptors. IEEE Trans. on Pattern Analysis and Machine Intelligence, 2005, 27(10): 1615-1630.

[doi:10.1109/TPAMI.2005.188] |

| [4] |

Dalal N, Triggs B. Histograms of oriented gradients for human detection. In: Proc. of the IEEE Conf. on Computer Vision and Pattern Recognition. 2005. 886-893.[doi: 10.1109/CVPR.2005.177]

|

| [5] |

Song KC, Yan YH, Chen WG, Zhang X. Research and perspective on local binary pattern. Acta Automatica Sinica, 2013, 39(6): 730-744.

[doi:10.1016/S1874-1029(13)60051-8] |

| [6] |

Calonder M, Lepetit V, Ozuysal M, Trzcinski T, Strecha C, Fua P. BRIEF:Computing a local binary descriptor very fast. IEEE Trans. on Pattern Analysis and Machine Intelligence, 2012, 34(7): 1281-1298.

[doi:10.1109/TPAMI.2011.222] |

| [7] |

Leutenegger S, Chli M, Siegwart RY. BRISK: Binary robust invariant scalable keypoints. In: Proc. of the Int'l Conf. on Computer Vision. 2011. 2548-2555.[doi: 10.1109/ICCV.2011.6126542]

|

| [8] |

Rublee E, Rabaud V, Konolige K, Bradski G. ORB: An efficient alternative to SIFT or SURF. In: Proc. of the Int'l Conf. on Computer Vision. 2011. 2564-2571.[doi: 10.1109/ICCV.2011.6126544]

|

| [9] |

Alahi A, Ortiz R, Vandergheynst P. FREAK: Fast retina keypoint. In: Proc. of the Computer Vision and Pattern Recognition. 2012. 510-517.[doi: 10.1109/CVPR.2012.6247715]

|

| [10] |

Fan B, Wu F, Hu Z. Rotationally invariant descriptors using intensity order pooling. IEEE Trans. on Pattern Analysis and Machine Intelligence, 2012, 34(10): 2031-2045.

[doi:10.1109/TPAMI.2011.277] |

| [11] |

Guan W, You S. Robust image matching with line context. In: Proc. of the British Machine Vision Conf. 2013.[doi: 10.5244/C.27.34]

|

| [12] |

Takacs G, Chandrasekhar V, Tsai SS, Chen DM, Grzeszczuk R, Girod B. Unified real-time tracking and recognition with rotation-invariant fast features. In: Proc. of the Computer Vision and Pattern Recognition. 2010. 934-941.[doi: 10.1109/CVPR.2010.5540116]

|

| [13] |

Chandrasekhar V, Takacs G, Chen DM, Tsai SS, Grzeszczuk R, Girod B. CHoG: Compressed histogram of gradients a low bit-rate feature descriptor. In: Proc. of the Computer Vision and Pattern Recognition. 2009. 2504-2511.[doi: 10.1109/CVPR.2009.5206733]

|

| [14] |

Wang Z, Fan B, Wu F. Local intensity order pattern for feature description. In: Proc. of the Int'l Conf. on Computer Vision. 2011. 603-610.[doi: 10.1109/ICCV.2011.6126294]

|

2019, Vol. 30

2019, Vol. 30