2. 兰州财经大学 信息工程学院, 甘肃 兰州 730020;

3. 计算机科学国家重点实验室(中国科学院 软件研究所), 北京 100190

2. School of Information Engineering, Lanzhou University of Finance and Economics, Lanzhou 730020, China;

3. State Key Laboratory of Computer Science, Institute of Software, The Chinese Academy of Sciences, Beijing 100190, China

大数据中的信息挖掘, 是当今计算机科学领域中的一个热门研究领域.然而, 绝大多数大数据中都包含了很多敏感的个人隐私信息, 如医疗记录、搜索引擎记录、电子商务数据、社会网络数据等[1, 2].如何以隐私保持的方式在隐私敏感数据集中挖掘有用信息, 在近二、三十年中一直是一个很活跃的研究领域[3].特别地, 随着差分隐私模型的引入, 隐私保持信息分析和挖掘在近年中得到了迅速的发展[4-8].然而, 这个领域还处于比较初级的发展阶段, 很多关键问题还没能得到解决.尽管差分隐私是一个有严格数学定义的隐私模型, 通过其可对数据集中的个人隐私信息进行很好的保护, 但是, 差分隐私模型也因其较差的数据有用性而得到很多批评——经差分隐私处理后数据的有用性要比经类k-匿名(如k-匿名、

对多查询问题(即同时对多个查询进行处理), 从查询函数的角度, (广义)最优机制问题可分为两个方面:函数压缩和(狭义)最优机制.函数压缩关注不同查询之间的相关性问题, 如线性相关性.函数压缩试图将相关性很高的多查询问题压缩为相关性较低的少量查询问题, 然后通过寻找后者的差分隐私机制来求解前者的差分隐私机制, 由此来减小噪声复杂度[20-22].(狭义)最优机制关注于低相关性函数查询的最优机制寻找问题.函数压缩问题可表述如下:对于相关性较高的m个查询问题g1(x), …, gm(x), 经过某种压缩算法, 可将其压缩为n( < m)个相关性很低的查询函数f1(x), …, fn(x).最简单情形, 存在一个m×n实值矩阵A, 满足g(x)=Af(x), 其中, g(x)=(g1(x), …, gm(x))T, f(x)=(f1(x), …, fn(x))T.若矩阵A是一个小元素矩阵(即A的每个元素都很小), 则通过研究关于查询函数f(x)的差分隐私机制, 就可以以后处理(post-processing)原理[5]通过表达式g(x)=Af(x)来找到g(x)的差分隐私机制.与文献[18]类似, 本文主要讨论(狭义)最优机制问题.也就是说:对于相关性很低的函数f(x), 需要找到最优差分隐私机制, 从而得到数据有用性最高的(或最精确的)对f(x)的查询反馈.在本文以下的分析中, 我们都假定多查询函数是低相关的, 因此无需关注其函数压缩.

1.1 本文贡献本文试图构造一些基本的分析方法来对差分隐私的最优机制问题进行分析.

首先, 不同于文献[18-24]中将最优机制问题归结为一个单目标函数优化问题, 本文引入了多目标函数优化模型来求解最优机制.这种多目标函数模型与其他单目标函数模型相比, 如Min-Max目标函数模型[18, 19], 具有很大优点:多目标模型将不同数据集对应分布的有用性的权衡问题剥离出了最优差分隐私机制问题, 这为分析差分隐私机制的最优性提供了方便.

其次, 本文引入了一种新的最优差分隐私机制分析方法.该分析方法受到了文献[25]中的梯子函数(ladder function)的启发, 将概率分布通过集合切分及合理测度赋值来达到数据有用性和隐私性的权衡.

最后, 针对线性查询问题, 本文寻找到了线性查询问题的一种近似最优机制(定理2).据我们所知, 定理2是关于线性查询最优机制的最全面的结论.并且, 本文的大部分分析方法对分析非线性查询问题的最优机制也是适用的, 比如, 第3节、第4节的内容都没有对函数类型进行限定.本文的深层目的是探讨差分隐私的深层数学结构.本文发现:一个数据集的邻居集合对应的查询函数值集合里面包含了差分隐私的一些非常重要的特征, 而敏感度只是该集合的极值特性.本文通过研究该集合中点的分布情况来探讨差分隐私的深层特征, 相关内容请参考第6节的讨论.

1.2 相关工作差分隐私的研究主要从3个关注点展开:数据隐私性、数据有用性(或噪声复杂度)及算法复杂度.对一个查询问题, 这三者之间相互冲突, 需要在他们之间进行权衡.

本文的研究关注于数据隐私性及数据有用性之间的权衡问题, 不考虑相关算法的复杂度问题.即:考虑在隐私保护程度确定的条件下, 获得有用性最高的查询结果时的机制寻找问题(即最优机制问题).前人分别从不同的角度对一些特殊的线性查询的最优机制问题进行了研究, 如单输出值查询[18, 19, 24, 29]、多输出连续实值查询[23]、多输出值查询噪声复杂度上下界及其逼近[17, 28]等.不同于先前的工作, 本文对一般的线性查询问题寻找最优机制, 并得出了相关结果(定理2), 扩展了在线性查询最优机制方面的结论.本文的分析方法其实是为了分析非线性查询问题而发展起来的一套分析理论, 因此也可以对非线性查询问题进行分析.

如第1节的分析, 另一类研究关注于多线性查询问题中各查询之间的相关性(如线性相关性)问题, 并试图将相关性很高的多查询问题压缩为相关性很低的少量查询以降低噪声复杂度[20-22].这一类研究关注于线性查询相关算法的隐私性、数据有用性及算法复杂度这3方面的权衡, 但并不强调相关机制的(噪声复杂度)最优性.

从统计学习的角度, 很多学者试图将关于数据集x的多线性查询转化为一个关于数据集y的对应多线性查询[30-32].该方法的理论基础是基于查询函数的统计特性及自变量的数据集的特性.这类研究关注噪声复杂度、计算复杂度的估计及与隐私之间的权衡, 没有强调最优机制问题.

敏感度方法是差分隐私中的一类重要方法, 如全局敏感度[27]、平滑敏感度[26]及局部敏感度[25]等.现在的绝大多数差分隐私算法都是通过敏感度方法来进行隐私分析的.本文的分析方法受到了文献[25]中梯子函数(ladder function)的极大启发.但文献[25]中梯子函数的方法还是基于(局部)敏感度, 而本文将该方法进行了改进, 使其脱离了敏感度方法, 并发展出一套与文献[25]完全不同的分析方法.并且, 文献[25]并不讨论机制的最优性及方法的推广.关于本文方法与敏感度方法之间的优劣比较见本文第6节的讨论.据我们所知, 本文方法是第一个不基于敏感度而能对非线性查询最优机制进行分析的方法.

2 问题形式化在本文中, 数据集(dataset)是一些记录(行向量)的多重集(multiset), 每个记录代表个体信息, 其形式化表示为[5, 17, 21]:设

本文主要研究线性查询(linear query)的最优机制.线性查询是一类很广泛的查询函数[5, 17, 21], 包括计数函数、列联表(contingency table)及范围查询(range query)等.线性查询f定义为f:

| $ f(x)=\sum\limits_{i=1}^{|\mathcal{X}|}{{{x}_{i}}}f({{\mathcal{X}}_{i}}), $ |

或(当

| $ f(x)=\sum\limits_{i=1}^{|\mathcal{Y}|}{{{y}_{i}}}f({{\mathcal{Y}}_{i}}), $ |

其中,

n个线性查询f1(x), …, fn(x)可定义为一个多输出值线性函数f的查询问题.当

| $ f\left( x \right)=Ax, $ |

其中, 矩阵A的元素aij=fi(

| $ f\left( x \right)=Ay, $ |

其中, y为数据集x(有限集)的直方图表示中非零元组成的列向量(y1, …, yk)T, 矩阵A的元素

差分隐私机制[5]是一类随机函数, 其输出是一个随机变量.设

定义1. 以

| $ \text{Pr}[M\left( x \right)\in S]\le \text{exp}(\varepsilon )\times \text{Pr}[M\left( y \right)\in S]. $ |

定义1说明, 差分隐私机制

当

本文以连续情形为例进行分析, 离散情形可类似处理.对于线性查询函数f:

在差分隐私的研究中, 有几种常用的衡量差分隐私输出有用性的模型, 最常用的为Min-Max模型[17, 18, 23], 即:

| $ \underset{\mathcal{M}}{\mathop{\arg \min }}\, \ \underset{x\in \mathcal{D}}{\mathop{\sup }}\, \int_{r\in {{\mathbb{R}}^{n}}}{\|f(x)-r{{\|}_{p}}{{p}^{x}}(r)\text{d}r}. $ |

不同于Min-Max等单目标函数优化模型, 本文使用多目标函数优化模型, 即:

| $ \underset{\mathcal{M}}{\mathop{\arg \min }}\, \{\int_{r\in {{\mathbb{R}}^{n}}}{\|f(x)-r{{\|}_{p}}{{p}^{x}}(r)\text{d}r}:x\in \mathcal{D}\}, $ |

其中, px(r)代表

现在将最优差分隐私机制问题归纳为如下的多目标优化问题.

| $ \left. \begin{align} &\underset{{{p}_{x}}:x\in \mathcal{D}}{\mathop{\arg \min }}\, \left\{ \int_{r\in {{\mathit{\mathbb{R}}}^{n}}}{\parallel f\left( x \right)-r\parallel _{p}\left. {{p}_{x}}\left( r \right)\text{d}r\in \mathcal{D} \right\}} \right. \\ &\text{s}\text{.t}\text{.对任意邻居}x, {x}'\text{及任意可测集}S\subseteq {{\mathit{\mathbb{R}}}^{n}}, \\ &\Pr \left[\mathcal{M}\left( x \right)\in S \right]\le \exp \left( \varepsilon \right)\times \Pr \left[\mathcal{M}\left( {{x}'} \right)\in S \right] \\ \end{align} \right\} $ | (1) |

上面的优化问题等价于:

| $ \left. \begin{align} &\underset{{{p}_{x}}:x\in \mathcal{D}}{\mathop{\arg \min }}\, \left\{ \int_{r\in {{\mathit{\mathbb{R}}}^{n}}}{\parallel f\left( x \right)-r{{\parallel }_{p}}\left. {{p}^{_{x}}}\left( r \right)\text{d}r\in \mathcal{D} \right\}} \right. \\ &\text{s}\text{.t}\text{.对任意邻居}x, {x}'\text{任意}\ r\subseteq {{\mathit{\mathbb{R}}}^{n}}\backslash B, \mu \left( B \right)=0 \\ &{{p}^{_{x}}}\left( r \right)\le {{e}^{\varepsilon }}{{p}^{_{{{x}'}}}}\left( r \right) \\ \end{align} \right\} $ | (2) |

其中, μ代表

对多目标函数优化问题(1) 或(2), 需要寻找(可能多个)密度函数族

对于集合

对于数据集x及相应密度函数px(r)=exp(εq(x, r)), 下面根据质量函数q(x, r)的值对集合

对数据集x∈

| $ \left. \begin{align} & \underset{\left( {{\mathcal{Q}}^{x}},{{\mathcal{R}}^{x}} \right):x\in \mathcal{D}}{\mathop{\arg \min }}\,\left\{ \sum\limits_{i=0}^{\infty }{\frac{\exp \left( \varepsilon z_{i}^{x} \right)}{{{\alpha }_{x}}}}\int_{r\in \mathbb{R}_{i}^{x}}{\parallel f\left( x \right)-r{{\parallel }_{p}}\text{d}r:x\in \mathcal{D}} \right\} \\ & \text{s}\text{.t}\text{.对任意邻居}x,{x}'\text{任意}\ i,j\subseteq \mathbb{N}\text{且满足}\mathcal{R}_{i}^{x}\cap R_{i}^{{{x}'}}\ne \varnothing ,\text{有} \\ & \exp \left( \varepsilon \left( z_{i}^{x}-z_{i}^{{{x}'}}-1 \right) \right)\le \frac{{{\alpha }_{x}}}{{{\alpha }_{{{x}'}}}} \\ \end{align} \right\} $ | (3) |

其中,

对数据集x∈

| $ \left. \begin{align} & \underset{\left( {{\mathcal{Q}}^{x}},{{\mathcal{R}}^{x}} \right):x\in \mathcal{D}}{\mathop{\arg \min }}\,\left\{ \int_{z\in {{\mathcal{Q}}^{x}}}{\frac{\exp \left( \varepsilon z \right)}{{{\alpha }_{x}}}\sum\limits_{r\in \mathcal{R}_{z}^{x}}{\parallel f\left( x \right)-r{{\parallel }_{p}}}\text{d}z:x\in \mathcal{D}} \right\} \\ & \text{s}\text{.t}\text{.对任意邻居}x,{x}'\text{任意}\ i,j\subseteq \mathbb{N}\text{且满足}\mathcal{R}_{i}^{x}\cap R_{i}^{{{x}'}}\ne \varnothing ,\text{有} \\ & \exp \left( \varepsilon \left( z_{i}^{x}-z_{i}^{{{x}'}}-1 \right) \right)\le \frac{{{\alpha }_{x}}}{{{\alpha }_{{{x}'}}}} \\ \end{align} \right\} $ | (4) |

其中,

根据上一节的结论, 差分隐私机制与集合对族{(

假设1. 对任意数据集x∈

注:假设1中,

基于假设1, 构造一类集合切分

引理1.对任意的邻居x, x'∈

证明:首先定义集合

由

记

另外, {Ix:x∈

我们的目的是对所有

本节讨论线性查询的最优机制问题.首先讨论当集合序列是极小集合序列{Ix:x∈

线性查询具有特殊的性质:对所有x∈

| $ I_{0}^{x}-f(x)=\varnothing, I_{1}^{x}-f(x)=\{f({x}')-f(x):{x}'\in {{\mathcal{N}}^{x}}\}=\{\pm f(s):s\in \mathcal{X}\}, $ |

再由

这个性质为构造对应的值序列提供了方便.将序列{Ix:x∈

| $ \left. \begin{align} &\underset{{{z}_{i}}, i\in \mathbb{N}}{\mathop{\arg \min }}\, \left\{ \frac{\sum\limits_{i=0}^{\infty }{\exp }(\varepsilon {{z}_{i}})\int_{r\in I_{i}^{x}}{\|f(x)-r{{\|}_{p}}\text{d}r}}{\sum\limits_{j=0}^{\infty }{\exp }(\varepsilon {{z}_{j}})\int_{r\in I_{j}^{x}}{\text{d}r}}:x\in \mathcal{D} \right\} \\ &\text{s}\text{.t}\text{. }对任意邻居x, {x}', 任意i, j\in \mathbb{N}且满足|i-j|\le 1及 \\ &\text{ }I_{i}^{x}\cap I_{j}^{{{x}'}}\ne \varnothing, 有{{z}_{i}}-{{z}_{j}}\le 1 \\ \end{align} \right\} $ | (5) |

下面分析质量序列{zi:i∈

引理2.设

证明:由于g(x)的导数

引理3.设f:

证明:该结论是积分中值定理的一个推论.

由引理3, 可得如下推论。

推论1.对所有t∈

定理1.设假设1成立, 则优化问题(5) 的最优质量序列为

证明:本定理使用数学归纳法证明, 其证明思路简述如下.

首先, 根据推论1、引理2及z0=0, 可得优化问题(6) 的最优解为z1=-1.

| $ \left. \begin{align} &\underset{{{z}_{1}}}{\mathop{\arg \min }}\, \left\{ \frac{\sum\limits_{i=0}^{1}{\exp }(\varepsilon {{z}_{i}})\int_{r\in I_{i}^{x}}{\|f(x)-r{{\|}_{p}}\text{d}r}}{\sum\limits_{j=0}^{1}{\exp }(\varepsilon {{z}_{j}})\int_{r\in I_{j}^{x}}{\text{d}r}}:x\in \mathcal{D} \right\} \\ &\text{s}\text{.t}\text{. }对任意邻居x, {x}', 任意i, j\in \{0, 1\}满足 \\ &\text{ }I_{i}^{x}\cap I_{j}^{{{x}'}}\ne \varnothing, 有{{z}_{i}}-{{z}_{j}}\le 1 \\ \end{align} \right\} $ | (6) |

接着, 设对所有t < k, 有zt=-t.下面证明zk=-k是如下优化问题(7) 的解, 而这个结论是推论1及假设(t < k时, 有zt=-t)的推论.

| $ \left. \begin{align} &\underset{{{z}_{t}}}{\mathop{\arg \min }}\, \left\{ \frac{\sum\limits_{i=0}^{t}{\exp }(\varepsilon {{z}_{i}})\int_{r\in I_{i}^{x}}{\|f(x)-r{{\|}_{p}}\text{d}r}}{\sum\limits_{j=0}^{t}{\exp }(\varepsilon {{z}_{j}})\int_{r\in I_{j}^{x}}{\text{d}r}}:x\in \mathcal{D} \right\} \\ &\text{s}\text{.t}\text{. }对任意邻居x, {x}', 任意i\in \{t-1, t\}满足 \\ &\text{ }I_{i}^{x}\cap I_{t}^{{{x}'}}\ne \varnothing, 有{{z}_{i}}-{{z}_{t}}\le 1 \\ \end{align} \right\} $ | (7) |

集合序列{Ix:x∈

找最优的集合序列, 即, 满足优化问题(8) 的最优解.

| $ \left. \begin{align} &\underset{{{\mathcal{R}}^{x}}:x\in \mathcal{D}}{\mathop{\arg \min }}\, \left\{ \frac{\sum\limits_{i=0}^{\infty }{\exp }(-\varepsilon i)\int_{r\in \mathcal{R}_{i}^{x}}{\|f(x)-r{{\|}_{p}}\text{d}r}}{\sum\limits_{j=0}^{\infty }{\exp }(-\varepsilon j)\int_{r\in \mathcal{R}_{j}^{x}}{\text{d}r}}:x\in \mathcal{D} \right\} \\ &\text{s}\text{.t}\text{. }对任意邻居x, {x}', 任意i, j\in \mathbb{N}满足 \\ &\text{ }\mathcal{R}_{i}^{x}\cap \mathcal{R}_{j}^{{{x}'}}\ne \varnothing, 有|i-j|\le 1 \\ \end{align} \right\} $ | (8) |

我们从极小序列{Ix:x∈

引理4.对任意的邻居x, x'∈

根据引理4及优化问题(8), 可构造无约束优化问题(9), 以求解参数δ:

| $ \underset{\delta }{\mathop{\arg \min }}\, \frac{\sum\limits_{i=0}^{\infty }{\exp }(-\varepsilon i)\int_{r\in \mathcal{R}_{i}^{x}}{\|f(x)-r{{\|}_{p}}\text{d}r}}{\sum\limits_{j=0}^{\infty }{\exp }(-\varepsilon j)\int_{r\in \mathcal{R}_{j}^{x}}{\text{d}r}} $ | (9) |

下面就概率密度族{(

| $ \mathcal{R}_{0}^{x}=\{r\in \mathcal{R}:d(f(x),r)\le {{\delta }^{*}}\},\mathcal{R}_{i}^{x}=\bigcup\nolimits_{{x}'\in {{\mathcal{N}}^{x}}}{\mathcal{R}_{i-1}^{{{x}'}}}\backslash \bigcup\nolimits_{j=0}^{i-1}{\mathcal{R}_{j}^{x}},z_{i}^{x}=-i,i\in \mathbb{N},x\in \mathcal{D}. $ |

δ*为优化问题(9) 的最优解.由于δ*是通过求解优化问题(9) 来找到的, 因此

现在将线性函数相关的最优机制问题归纳为如下的结论.

定理2.设假设1成立.设f:

| $ {{\mathcal{Q}}^{x}}=\{z_{i}^{x}=-i:i\in \mathbb{N}\},{{\mathcal{R}}^{x}}=\{\mathcal{R}_{i}^{x}:i\in \mathbb{N}\},\mathcal{R}_{0}^{x}=\{r:\|r-f(x){{\|}_{p}}\le \delta *\},\mathcal{R}_{i}^{x}={\bigcup\nolimits_{{x}'\in {{\mathcal{N}}^{x}}}{\mathcal{R}_{i-1}^{{{x}'}}}}/{\bigcup\nolimits_{j=0}^{i-1}{\mathcal{R}_{j}^{x}}}\; $ |

及

| $ {{\delta }^{*}}=\underset{\delta }{\mathop{\arg \min }}\,\frac{\sum\limits_{i=0}^{\infty }{\exp }(-\varepsilon i)\int_{r\in \mathcal{R}_{i}^{x}}{\|f(x)-r{{\|}_{p}}\text{d}r}}{\sum\limits_{j=0}^{\infty }{\exp }(-\varepsilon j)\int_{r\in \mathcal{R}_{j}^{x}}{\text{d}r}}. $ |

注释:本文使用先实现差分隐私再提高有用性的策略来达到隐私和有用性之间的权衡.首先, 我们寻找实现差分隐私所需设置的最小点集.具体说来, 对数据集x, 我们将x的邻居集对应的函数值的集合设置为

不过, 需要说明的是, 本文的方法没能实现真正意义上的机制最优性.最优机制需要找到一个密度函数族{px(r):x∈

本节通过实际例子来解释本文的方法并分析其性质.

设f:

考虑

算法1.生成概率密度函数.

输入:3个递增的正实数a, b, c, 正实数δ及ε, 迭代次数n;

//设集合序列{

输出:概率密度函数{(pi(r), Ri):i∈

步骤1:设置I0={0};

步骤2://计算集合序列Ii

For i=1 to n{

对每个区间[s, e]∈Ii-1 {

将4个区间[s, e+a], [s+b, e+c], [s-a, e], [s-c, e-b]存入集合Ii中;

}

计算

}

步骤3: //计算集合序列

For i=0 to n {

对每个区间[s, e]∈Ii {

将区间[s-δ, e+δ]存入集合

}

计算

}

//设

步骤4:计算

步骤5:计算α=sum1+sum2;

步骤6:设置pi(r)=exp(-iε)/α, 其中, r∈Ri, i∈

步骤7:Return {(pi(r), Ri):i∈

算法1需要下面的集合序列收敛性质:

定义2.设

| $ {\mathcal{R}_{n}}=\pm ({{a}_{n}}+[0,\Delta f])且{\mathcal{R}_{n}}_{+1}=\pm ({{a}_{n}}+[\Delta f,2\Delta f]). $ |

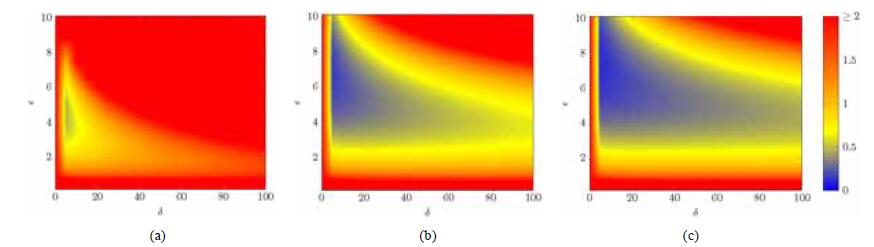

我们的实验设计如下:首先, 计算算法1生成的密度函数的数学期望值

我们构造两组实验:第1组使用相同的敏感度及不同的函数邻居集测度, 第2组使用不同的敏感度及相同的函数邻居集测度.第1组实验有4个不同的查询函数f1, f2, f3, f4, 其邻居集分别为

|

Fig. 1 图 1 |

图 1的4个子图分别代表了

第2组实验有3个查询函数, 其邻居集分别为

|

Fig. 2 图 2 |

图 2的3个子图分别代表了

综合图 1、图 2的结果, 我们可以得到如下的结论:若查询函数的邻居集V的敏感度Δf与其测度μ(

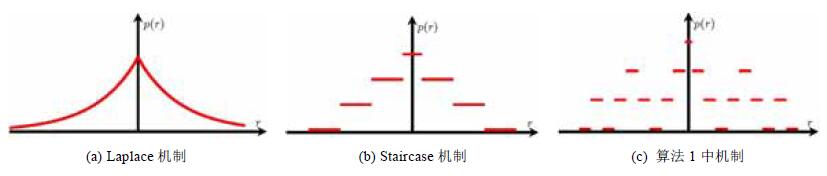

Laplace机制、Staircase机制及算法1中机制的密度函数如图 3所示.图 3(c)的密度函数与前两个密度函数的显著区别是:密度函数并不是从中心向两边递减的, 而是总体递减, 但是局部有增的密度函数.这种密度函数更适合于Δf/μ(

|

Fig. 3 The density functions of Laplace mechanism, Staircase mechanism and the mechanism in algorithm 1 图 3 Laplace机制、Staircase机制、算法1中机制的密度函数 |

算法2是算法1生成的密度函数的随机变量生成算法.

算法2.生成随机变量.

输入:敏感度Δf、迭代次数n、{

//设

输出:随机变量X.

步骤1:以exp(-iε)μ(

步骤2:If步骤1输出值i∈{0, 1, …, n} then

在

Return x;

Else

从参数为1-exp(-ε)的几何分布中抽样出一个整数j;

从[-an-(j+1)Δf, -an-jΔf]∪[an+jΔf, an+(j+1)Δf]中均匀随机抽样出一个数y;

Return y;

6.1 时间复杂度算法1和算法2的时间复杂度由集合序列{

若{

传统的观点认为, 查询函数的(全局或局部)敏感度是查询函数噪声复杂度的(最主要)标志.本文的结论发现:敏感度其实只是查询函数的邻居集

第6节的实际例子也说明, 本文的方法一般要比Laplace机制及Staircase机制更精确.但是本文的方法具有很高的时间复杂度, 不适合于直接使用在大数据集上.如何通过本文的方法和结论构造低时间复杂度的非敏感度方法, 将作为未来的一项工作.

另外, 本文的很多分析方法和结论(如第3节、第4节中的内容都没有设定函数类型)也可对非线性查询问题[15, 16, 34-36]进行分析, 因为非线性查询问题具有更加复杂的邻居集.至于其分析有效程度如何, 还需要进一步探索.非线性查询问题将具有更加复杂的最优机制, 不同数据集将对应形状各异的密度函数, 对非线性函数的非敏感度机制研究将作为未来的另一项工作.

致谢 本文作者感谢匿名审稿专家对本文初稿提出的宝贵建议和意见, 这些建议和意见对本文的完整性及易读性有很大的帮助.同时, 这些建议和意见促使我们发现了初稿中的一个证明错误.| [1] |

Ganta SR, Kasiviswanathan SP, Smith A. Composition attacks and auxiliary information in data privacy. In:Proc. of the 14th ACM SIGKDD Int'l Conf. on Knowledge Discovery and Data Mining. 2008. 265-273.[doi:10.1145/1401890.1401926] |

| [2] |

Narayanan A, Shmatikov V. Robust de-anonymization of large sparse datasets. In:Proc. of the 2008 IEEE Symp. on Security and Privacy (S&P 2008). 2008. 111-125.[doi:10.1109/SP.2008.33] |

| [3] |

Aggarwal CC, Yu PS. Privacy-Preserving data mining-Models and algorithms. In:Proc. of the Advances in Database Systems, Vol.34. Springer-Verlag, 2008.[doi:10.1007/978-0-387-70992-5] |

| [4] |

Dwork C. A firm foundation for private data analysis. Communications of the ACM, 2011, 54(1): 86–95.

[doi:10.1145/1866739.1866758] |

| [5] |

Dwork C, Roth A. The algorithmic foundations of differential privacy. Foundations and Trends in Theoretical Computer Science, 2014, 9(3-4): 211–407.

[doi:10.1561/0400000042] |

| [6] |

Jain P, Thakurta A. Differentially private learning with kernels. In:Proc. of the 30th Int'l Conf. on Machine Learning. 2013. 118-126.http://proceedings.mlr.press/v28/jain13.html |

| [7] |

Zhang J, Zhang ZJ, Xiao XK, Yang Y, Winslett M. Functional mechanism:Regression analysis under differential privacy. Proc. of the VLDB Endowment, 2012, 5(11): 1364–1375.

[doi:10.14778/2350229.2350253] |

| [8] |

Zhang J, Cormode G, Procopiuc CM, Srivastava D, Xiao XK. Privbayes:Private data release via bayesian networks. In:Proc. of the 2014 ACM SIGMOD Int'l Conf. on Management of Data. 2014. 1423-1434.[doi:10.1145/2588555.2588573] |

| [9] |

Li NH, Qardaji W, Su D. Provably private data anonymization:Or, k-anonymity meets differential privacy. CERIAS Tech Report, 2010.

|

| [10] |

Soria-Comas J, Domingo-Ferrer J, Sánchez D, Martínez S. Enhancing data utility in differential privacy via microaggregationbased k-anonymity. The Int'l Journal on Very Large Data Bases, 2014, 23(5): 771–794.

[doi:10.1007/s00778-014-0351-4] |

| [11] |

Kasiviswanathan SP, Lee HK, Nissim K, Raskhodnikova S, Smith AD. What can we learn privately? In:Proc. of the IEEE 49th Annual IEEE Symp. on Foundations of Computer Science. 2008, 40(3):793-826.[doi:10.1109/FOCS.2008.27] |

| [12] |

Wasserman L, Zhou S. A statistical framework for differential privacy. Journal of the American Statistical Association, 2010, 105(489): 375–389.

[doi:10.1198/jasa.2009.tm08651] |

| [13] |

Chaudhuri K, Hsu D. Convergence rates for differentially private statistical estimation. In:Proc. of the Int'l Conf. on Machine Learning. 2012. 1327-1334. |

| [14] |

Kellaris G, Papadopoulos S, Xiao XK, Papadias D. Differentially private event sequences over infinite streams. Proc. of the VLDB Endowment, 2014, 7(12): 1155–1166.

[doi:10.14778/2732977.2732989] |

| [15] |

Karwa V, Raskhodnikova S, Smith AD, Yaroslavtsev G. Private analysis of graph structure. ACM Trans. on Database Systems, 2014, 39(3): 1–22:33.

[doi:10.1145/2611523] |

| [16] |

Chaudhuri D, Sarwate AD, Sinha K. A near-optimal algorithm for differentially-private principal components. Journal of Machine Learning Research, 2013, 14(1): 2905–2943.

|

| [17] |

Nikolov A, Talwar D, Zhang L. The geometry of differential privacy:The sparse and approximate cases. In:Proc. of the Annual ACM Symp. on Theory of Computing., 2013: 351–360.

[doi:10.1145/2488608.2488652] |

| [18] |

Geng Q, Viswanath P. The optimal noise-adding mechanism in differential privacy. IEEE Trans. on Information Theory, 2016, 62(2): 925–951.

[doi:10.1109/TIT.2015.2504967] |

| [19] |

Gupte M, Sundararajan M. Universally optimal privacy mechanisms for minimax agents. In:Proc. of the 29th ACM SIGMODSIGACT-SIGART Symp. on Principles of Database Systems. 2010. 135-146.[doi:10.1145/1807085.1807105] |

| [20] |

Li C, Miklau G. Optimal error of query sets under the differentially-private matrix mechanism. In:Proc. of the 16th Int'l Conf. on Database Theory. 2013. 272-283.[doi:10.1145/2448496.2448529] |

| [21] |

Yaroslavtsev G, Cormode G, Procopiuc CM, Srivastava D. Accurate and efficient private release of datacubes and contingency tables. In:Proc. of the IEEE 29th Int'l Conf. on Data Engineering (ICDE). 2013. 745-756.[doi:10.1109/ICDE.2013.6544871] |

| [22] |

Wang ZT, Fan K, Zhang JQ, Wang LW. Efficient algorithm for privately releasing smooth queries. In:Proc. of the Advances in Neural Information Processing Systems. 2013. 782-790. |

| [23] |

Geng Q, Viswanath P. Optimal noise adding mechanisms for approximate differential privacy. IEEE Trans. on Information Theory, 2016, 62(2): 952–969.

[doi:10.1109/TIT.2015.2504972] |

| [24] |

Brenner H, Nissim K. Impossibility of differentially private universally optimal mechanisms. In:Proc. of the 51st IEEE Annual Symp. on Foundations of Computer Science. 2010. 71-80[doi:10.1109/FOCS.2010.13]http://ieeexplore.ieee.org/document/5670945/?tp=&arnumber=5670945&contentType=Conference%20Publications&sortType%3Dasc_p_Sequence%26filter%3DAND(p_IS_Number:5670813) |

| [25] |

Zhang J, Cormode G, Procopiuc CM, Srivastava D, Xiao XK. Private release of graph statistics using ladder functions. In:Proc. of the 2015 ACM SIGMOD Int'l Conf. on Management of Data. 2015. 731-745.[doi:10.1145/2723372.2737785] |

| [26] |

Raskhodnikova S, Smith AD. Smooth sensitivity and sampling in private data analysis. In:Proc. of the 39th Annual ACM Symp. on Theory of Computing. 2007. 75-84.[doi:10.1145/1250790.1250803]http://dblp.uni-trier.de/db/conf/stoc/stoc2007.html |

| [27] |

Dwork C. Differential privacy. In:Proc. of the Int'l Colloquium on Automata, Languages, and Programming, 2006. 1-12.[doi:10.1007/978-3-540-79228-4_1] |

| [28] |

Hardt M, Talwar K. On the geometry of differential privacy. In:Proc. of the 42nd ACM Symp. on Theory of Computing. 2010. 705-714.[doi:10.1145/1806689.1806786] |

| [29] |

Ghosh A, Roughgarden T, Sundararajan M. Universally utility-maximizing privacy mechanisms. In:Proc. of the 41st ACM Symp. on Theory of Computing. 2009. 351-360.[doi:10.1145/1536414.1536464] |

| [30] |

Gupta A, Roth A, Ullman J. Iterative constructions and private data release. In:Proc. of the 9th Int'l Conf. on Theory of Cryptography. 2012. 339-356.[doi:10.1007/978-3-642-28914-9_19]http://dl.acm.org/citation.cfm?id=2238961 |

| [31] |

Roth A, Roughgarden T. Interactive privacy via the median mechanism. In:Proc. of the 42nd ACM Symp. on Theory of Computing. 2010. 765-774.[doi:10.1145/1806689.1806794]http://128.84.21.199/abs/0911.1813?context=cs |

| [32] |

Hardt M, Ligett K, McSherry F. A simple and practical algorithm for differentially private data release. In:Proc. of the Advances in Neural Information Processing Systems. 2010. 2339-2347.http://adsabs.harvard.edu/abs/2010arXiv1012.4763H |

| [33] |

Collette Y, Siarry P. Multiobjective Optimization:Principles and Case Studies. Springer Science & Business Media, 2013: 15–43.

http://ci.nii.ac.jp/ncid/BA71265745 |

| [34] |

Lu GQ, Zhang XJ, Ding LP, Li YF, Liao X. Frequent sequential pattern mining under differential privacy. Journal of Computer Research and Development, 2015, 52(12): 2789–2801(in Chinese with English abstract).

[doi:10.7544/issn1000-1239.2015.20140516] |

| [35] |

Ouyang J, Yin J, Liu SP. Differential privacy publishing strategy for distributed transaction data. Ruan Jian Xue Bao/Journal of Software, 2015, 26(6):1457-1472(in Chinese with English abstract). http://www.jos.org.cn/1000-9825/4526.htmhttp://doi:10.13328/j.cnki.jos.004576 |

| [36] |

Chen SX. New methods for linear queries in providing differential privacy protection[Ph.D. Thesis]. Shanghai:Fudan University, 2012(in Chinese with English abstract). |

| [34] |

卢国庆, 张啸剑, 丁丽萍, 李彦峰, 廖鑫. 差分隐私下的一种频繁序列模式挖掘方法. 计算机研究与发展, 2015, 52(12): 2789–2801.

[doi:10.7544/issn1000-1239.2015.20140516]

|

| [35] |

欧阳佳, 印鉴, 刘少鹏. 一种分布式事务数据的差分隐私发布策略. 软件学报, 2015, 26(6): 1457-1472. http://www.jos.org.cn/1000-9825/4526.htmdoi:10.13328/j.cnki.jos.004576

|

| [36] |

陈世熹. 提供差分隐私保护的线性查询新方法[博士学位论文]. 上海: 复旦大学, 2012.

|

2017, Vol. 28

2017, Vol. 28